Lmarena: la arena de batalla que define al "mejor" chatbot de IA

Introducción: ¿qué es lmarena y por qué es tan influyente?

En el vertiginoso ecosistema de la inteligencia artificial, donde nuevos modelos de lenguaje (LLMs) surgen casi semanalmente, una pregunta resuena con fuerza: ¿cuál es el mejor? Lejos de los laboratorios y los benchmarks académicos, una plataforma ha emergido como el árbitro de facto en esta contienda, capturando la atención de desarrolladores, inversores y el público general. Su nombre es LMArena.

LMArena, anteriormente conocida como Chatbot Arena, es una plataforma abierta y colaborativa (crowdsourcing) donde cualquier persona puede enfrentar a dos modelos de IA anónimos en una "batalla" de ingenio, para luego votar por la respuesta superior. Lo que comenzó en 2023 como un proyecto de investigación de LMSYS en la Universidad de California, Berkeley, diseñado para evaluar LLMs en condiciones del "mundo real", ha evolucionado a una velocidad asombrosa. Hoy, es descrita por medios como TechCrunch como una "obsesión de la industria" y se ha constituido como una empresa con una financiación de 100 millones de dólares, consolidando su posición como un actor central en el futuro de la IA.

La necesidad de una plataforma como LMArena surgió de las limitaciones de las métricas tradicionales. Benchmarks como MMLU o HELM, aunque valiosos, evalúan modelos en tareas predefinidas y con respuestas cerradas, fallando en capturar la fluidez, creatividad y utilidad en conversaciones abiertas y dinámicas, que es como la mayoría de la gente interactúa con los chatbots. LMArena llenó este vacío al proponer una solución radicalmente simple: dejar que la gente decida.

Este artículo no solo servirá como una guía práctica sobre cómo utilizar LMArena para poner a prueba la IA, sino que también se sumergirá en un análisis profundo de su metodología, sus controversias y, lo más importante, cómo esta "arena de gladiadores digitales" está moldeando activamente la percepción pública y profesional de la inteligencia artificial, definiendo quién gana y quién pierde en la carrera tecnológica más importante de nuestro tiempo.

Cómo usar lmarena: una guía práctica para poner a prueba la IA

La genialidad de LMArena reside en su simplicidad y accesibilidad. No se requiere ser un experto en IA para participar; solo curiosidad y un prompt. La plataforma está diseñada para que cualquier usuario, desde un estudiante hasta un desarrollador profesional, pueda contribuir al proceso de evaluación. A continuación, se detalla el funcionamiento de sus modos principales.

Acceso y modos de uso

El corazón de la plataforma es el Modo Batalla (Arena/Battle), el único que influye directamente en el prestigioso leaderboard. El proceso es intuitivo y se desarrolla en varios pasos clave:

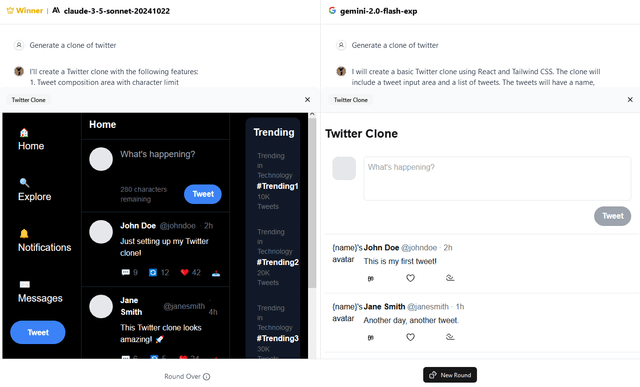

- Introducir un Prompt: El usuario escribe una pregunta, una orden o cualquier tipo de instrucción en el cuadro de texto. Puede ser cualquier cosa, desde "Escribe un poema sobre la lluvia en Marte" hasta "Genera el código en Python para un clon de Twitter".

- Respuestas Anónimas: La plataforma envía el prompt a dos modelos de lenguaje seleccionados al azar, cuyas identidades permanecen ocultas. Se presentan como "Modelo A" y "Modelo B". Esta anonimidad es crucial para evitar sesgos de marca.

- Comparación y Votación: El usuario analiza ambas respuestas y decide cuál es superior. Las opciones de voto son claras: "A es mejor", "B es mejor", "Empate (ambos son buenos)" o "Ambos son malos". No hay presión para votar si el usuario no está seguro.

- La Revelación: Inmediatamente después de emitir el voto, LMArena revela las identidades de los modelos que compitieron. Este momento de "desenmascaramiento" es a la vez educativo y adictivo, permitiendo al usuario aprender sobre las fortalezas y debilidades de cada IA.

Además del modo principal, LMArena ofrece otras herramientas para una exploración más dirigida:

- Side-by-Side Chat: Permite al usuario elegir dos modelos específicos y compararlos directamente, pero esta vez conociendo sus identidades desde el principio.

- Direct Chat: Ofrece una conversación directa con un único modelo seleccionado por el usuario.

Es importante destacar que, aunque los datos de estos modos se recopilan para investigación, los prompts y votos en Side-by-Side y Direct Chat no contribuyen al ranking del leaderboard, ya que la falta de anonimato introduciría sesgos.

Explorando las diferentes "arenas"

LMArena ha expandido su campo de batalla más allá del texto. Reconociendo que la IA es cada vez más multimodal, la plataforma alberga diferentes ";Arenas" con sus propios leaderboards especializados, permitiendo una evaluación más granular de las capacidades de los modelos:

- Text Arena: La arena original y más popular, para tareas de lenguaje general.

- Vision Arena: Para modelos multimodales que pueden analizar y responder preguntas sobre imágenes .

- Coding Arena: Enfocada en la generación y depuración de código.

- Text-to-Image Arena: Donde se comparan modelos de generación de imágenes a partir de texto, como el famoso caso de "nano-banana".

- WebDev Arena: Una arena más reciente donde los modelos son desafiados a construir sitios web funcionales a partir de un prompt.

El rol del usuario: un voto para la ciencia ciudadana

Cada interacción en LMArena es una contribución a un masivo experimento de ciencia ciudadana. La plataforma enfatiza que cada voto, sin importar la experiencia del usuario, es valioso. Estos datos de preferencia humana no solo alimentan el leaderboard, sino que también se comparten (de forma anónima) con los desarrolladores de los modelos. Este bucle de retroalimentación directa del "mundo real" es invaluable para que los laboratorios de IA puedan identificar debilidades, refinar el tono de sus modelos y, en última instancia, construir una IA más útil y alineada con las expectativas humanas.

El motor de lmarena: cómo se mide la "inteligencia" con el sistema elo

Para traducir millones de votos subjetivos en un ranking aparentemente objetivo, LMArena necesitaba un sistema robusto, dinámico y escalable. La solución no provino del mundo de la informática, sino del ajedrez: el sistema de puntuación Elo.

El desafío de la evaluación de llms

Evaluar un LLM es notoriamente difícil. Como señaló el equipo de LMSYS en su publicación inicial, los benchmarks académicos tradicionales, aunque útiles, presentan varias desventajas para medir la calidad de los asistentes de chat modernos:

| Método de Evaluación | Fuente de Preguntas | Evaluador | Métricas | Limitaciones |

|---|---|---|---|---|

| HELM / lm-evaluation-harness | Datasets académicos | Programa | Métricas básicas (ej. exactitud) | No evalúa bien preguntas abiertas; no se basa en comparación por pares. |

| Evaluación basada en GPT-4 | Generadas por humanos/IA | Otro LLM (GPT-4) | Tasa de victorias | Puede tener sesgos del modelo evaluador; no es escalable de forma incremental. |

| LMArena (Chatbot Arena) | Prompts de usuarios ("en la naturaleza") | Humano (Crowdsourcing) | Puntuación Elo | Refleja preferencias humanas reales en tareas abiertas y creativas. |

El problema fundamental es que para preguntas abiertas ("open-ended"), la "calidad" es subjetiva. No hay una única respuesta correcta. LMArena abordó esto adoptando la comparación por pares (pairwise comparison) como su núcleo, y el sistema Elo como el mecanismo para agregar esas comparaciones.

La solución: crowdsourcing + sistema de puntuación elo

El sistema Elo fue desarrollado por Arpad Elo para calcular la habilidad relativa de los jugadores de ajedrez. Su lógica es elegante y se adapta perfectamente al formato de "batalla" de LMArena.

- ¿Qué es el Sistema Elo? Es un método que asigna una puntuación numérica a cada "jugador" (en este caso, un LLM). Esta puntuación no es absoluta, sino relativa a la de los demás jugadores en el sistema. La diferencia de puntuación entre dos jugadores predice el resultado de una partida entre ellos.

- Adaptación a la IA: En LMArena, cada batalla entre el Modelo A y el Modelo B es una "partida". Si el Modelo A (con menor puntuación Elo) vence al Modelo B (con mayor puntuación), el Modelo A ganará muchos puntos Elo, y el Modelo B perderá una cantidad equivalente. Si el favorito (Modelo B) gana, el intercambio de puntos es mucho menor. Los empates también producen pequeños ajustes.

- La Fórmula de la Probabilidad: La probabilidad de que el jugador A gane contra el jugador B se calcula con una curva logística. La fórmula exacta utilizada por LMArena es:

P(A gana) = 1 / (1 + 10^((Rb - Ra) / 400)), dondeRayRbson las puntuaciones Elo de los modelos A y B. - Por qué Funciona: Este sistema es ideal porque es dinámico (se actualiza con cada voto), escalable (puede manejar cientos de modelos) e incremental. Refleja las preferencias humanas en tiempo real y captura la habilidad relativa de los modelos en un amplio espectro de tareas propuestas por una comunidad global y diversa.

El primer vistazo al ranking: el leaderboard de mayo de 2023

Para comprender la evolución, es útil observar uno de los primeros leaderboards publicados por LMArena. Basado en 4,700 votos iniciales, este ranking ya mostraba la capacidad del sistema Elo para diferenciar el rendimiento de los modelos pioneros de código abierto.

Moldeando la percepción: cómo lmarena define quién gana la carrera de la IA

Más allá de ser una herramienta de evaluación, LMArena se ha convertido en una poderosa fuerza cultural y de mercado. Su influencia se extiende desde los titulares de los medios de comunicación hasta las estrategias de desarrollo de los laboratorios de IA más grandes del mundo. Analizar cómo moldea la percepción requiere examinar su impacto en tres frentes: el público, los desarrolladores y la psicología de la preferencia humana.

A. para el público y los medios: creando un "campeón" de IA

El leaderboard de LMArena ha logrado algo extraordinario: ha convertido una competencia tecnológica abstracta y compleja en una narrativa deportiva, fácil de seguir y cargada de drama. La tabla de clasificación, con sus ascensos y caídas, crea "campeones", "retadores" y "sorpresas", un lenguaje universal que los medios y el público entienden perfectamente.

Casos de estudio de impacto mediático

- El Ascenso de Claude 3: En marzo de 2024, Claude 3 de Anthropic superó por primera vez a la serie GPT-4 de OpenAI en el leaderboard. Medios como Ars Technica publicaron titulares como "'El rey ha muerto'", señalando un cambio sísmico en el liderazgo de la IA. LMArena proporcionó la "prueba" tangible de este cambio, validando las afirmaciones de Anthropic con datos de preferencia humana a gran escala.

- El Misterio de "nano-banana": En agosto de 2025, un modelo de generación de imágenes completamente desconocido, con el seudónimo "nano-banana", apareció en la arena y rápidamente escaló hasta el puesto número 1, superando a todos los competidores establecidos. El fenómeno se volvió viral, con la comunidad de IA especulando febrilmente sobre su origen. Finalmente se reveló que era una versión de prueba de Gemini 2.5 Flash de Google. Este evento no solo demostró el poder de LMArena para generar expectación, sino que también funcionó como una brillante campaña de marketing de guerrilla para Google.

Este efecto narrativo es profundo. LMArena no solo mide la percepción, la crea. Al presentar los modelos como competidores en una liga, les otorga "personalidades" y fomenta una cultura de fans y detractores. El progreso de la IA se vuelve tangible, medible y emocionante, transformando a los usuarios de simples consumidores a espectadores y jueces de la carrera tecnológica.

B. para los desarrolladores: un campo de pruebas y marketing

Para los laboratorios de IA, desde gigantes como Google y OpenAI hasta equipos de código abierto, LMArena se ha vuelto una herramienta indispensable con un doble propósito: evaluación y marketing.

- Plataforma de Pruebas Pre-lanzamiento: Como reveló el caso de "nano-banana" y otros seudónimos como "summit" (asociado a OpenAI), las grandes empresas utilizan LMArena para probar en secreto sus modelos de próxima generación. Esto les permite obtener feedback del mundo real sobre múltiples variantes de un modelo antes de decidir cuál lanzar oficialmente. Es una forma de "test A/B" a una escala masiva y con una diversidad de prompts imposible de replicar internamente.

- Feedback Invaluable del Mundo Real: Según el CTO de LMArena, Wei-Lin Chiang, las empresas reciben informes detallados sobre el rendimiento de sus modelos. Estos análisis desglosan fortalezas y debilidades en categorías específicas como codificación o escritura creativa, basándose en miles de votos de usuarios. Este feedback es crucial para alinear los modelos con las preferencias humanas reales.

- Sello de Aprobación y Herramienta de Marketing: Una alta clasificación en LMArena se ha convertido en un poderoso argumento de venta. Google, por ejemplo, destacó en su comunicado de prensa que Gemini 2.5 Pro debutó en la cima del leaderboard. Este ranking, basado en "votos humanos", se percibe como más auténtico y creíble que los benchmarks internos, y las empresas lo utilizan para validar la calidad y superioridad de sus productos.

C. la psicología de la preferencia: ¿qué hace que una respuesta sea "mejor"?

Quizás el aporte más fascinante de LMArena es lo que revela sobre la psicología de la preferencia humana al interactuar con la IA. La "mejor" respuesta raramente es solo la más precisa. El propio equipo de LMArena ha publicado investigaciones que desglosan los factores que influyen en los votos de los usuarios.

En un estudio notable llamado "Sentiment Control", los investigadores analizaron cómo el tono emocional de una respuesta afecta su probabilidad de ganar una batalla. Los resultados son reveladores: el estilo y el sentimiento son tan importantes, si no más, que la sustancia.

"Descubrimos que el estilo —incluyendo formato y longitud— juega un papel significativo en la calidad percibida del modelo. Sin embargo, nuestra hipótesis era que el estilo va más allá del diseño; quizás el sentimiento y los emojis son igual de influyentes." - LMArena Research, abril de 2025

El estudio demostró que las respuestas con un tono Positivo o Muy Positivo dominan abrumadoramente. Una respuesta ";Muy Positiva" tiene un 78% de probabilidad de ganar contra una "Negativa" y un 64% contra una "Neutral";. Sorprendentemente, las respuestas neutrales, puramente factuales y secas, son las que peor rinden, perdiendo contra casi todos los demás tonos. Esto sugiere que los usuarios prefieren una IA que parezca comprometida, amigable y expresiva, en lugar de una que simplemente entregue datos.

Incluso un tono "Muy Negativo" puede ser preferido en ciertos contextos, como cuando un usuario pide explícitamente que se le "critique" o se burlen de él ("Roast me"). En esos casos, un chatbot que se adhiere a la negatividad solicitada es recompensado por cumplir con la intención del usuario.

Estos hallazgos demuestran que la ";percepción" de la calidad de una IA es una construcción compleja y subjetiva. No se trata solo de la veracidad de la información, sino de la experiencia de la interacción. El formato, la elocuencia, el uso de emojis y el tono emocional son factores decisivos que LMArena, a través de su metodología de crowdsourcing, es capaz de capturar y cuantificar.

Debates y críticas: ¿es lmarena un juez imparcial?

A pesar de su innegable influencia, o quizás debido a ella, LMArena no está exenta de escrutinio. Han surgido importantes debates y críticas que cuestionan la imparcialidad de su metodología y la validez de la percepción que construye. Estas críticas provienen tanto de la comunidad académica como de investigadores de la industria.

A. acusaciones de sesgo y "overfitting" al leaderboard

La crítica más contundente se resume en un estudio conocido como "La Ilusión del Leaderboard". El argumento central es que el sistema de LMArena, aunque bien intencionado, puede favorecer a las grandes corporaciones con vastos recursos.

- La "Ilusión del Leaderboard": Investigadores de Cohere, Princeton y MIT señalaron que las grandes empresas pueden "jugar" con el sistema. Meta, por ejemplo, probó 27 variantes privadas de su modelo Llama-4 en la arena, pero solo la de mejor rendimiento fue finalmente añadida al leaderboard público. Esta práctica, denominada "overfitting" al benchmark, puede inflar artificialmente la clasificación de un modelo, ya que representa el pico de rendimiento de docenas de intentos, no el rendimiento típico.

- Desventaja para el Código Abierto: Esta capacidad de iterar y probar a gran escala crea una desventaja inherente para los equipos de código abierto y los laboratorios más pequeños, que no disponen de los mismos recursos para optimizar sus modelos específicamente para el gusto de los votantes de LMArena.

- Vulnerabilidad a la Manipulación: Aunque LMArena tiene mecanismos para detectar comportamientos anómalos, algunos estudios teóricos han explorado la posibilidad de manipular los rankings mediante votos coordinados o "amañados". La dependencia total de los votos de la comunidad hace que el sistema sea, en teoría, susceptible a este tipo de ataques.

B. cuestionamientos a la metodología

Más allá del sesgo, algunos académicos han cuestionado los fundamentos mismos de la metodología de LMArena.

- Validez del Sistema Elo: Se ha planteado si un sistema diseñado para juegos de suma cero como el ajedrez, donde hay un ganador y un perdedor claros, es el más adecuado para evaluar tareas lingüísticas abiertas y subjetivas. En una conversación, puede que no haya una respuesta objetivamente "mejor", sino simplemente diferente.

- La Crítica de la "Validez de Constructo": La profesora Emily Bender, una voz crítica prominente en el campo de la IA, ha cuestionado si LMArena realmente mide lo que dice medir. Según ella, "LMArena no ha demostrado que votar por una respuesta sobre otra se correlacione realmente con las preferencias, como sea que estas se definan". En otras palabras, un simple voto de preferencia podría no capturar un concepto bien definido y estable de "calidad" o "utilidad".

- Ética del Crowdsourcing: Otro debate se centra en el modelo de trabajo. LMArena se basa en el trabajo de millones de "voluntarios" no remunerados. Críticos como Asmelash Teka Hadgu argumentan que los evaluadores deberían ser compensados por su trabajo, especialmente porque genera un enorme valor comercial para las empresas de IA y para la propia LMArena.

El sesgo inherente a la comunidad de votantes también es una preocupación. Los datos iniciales ya mostraban un fuerte dominio del inglés, lo que significa que las preferencias y los rankings pueden no ser representativos para usuarios de otras lenguas y culturas.

C. la respuesta de lmarena: transparencia y evolución constante

Frente a estas críticas, el equipo de LMArena ha adoptado una postura de transparencia y mejora continua, arraigada en su origen académico. Lejos de ignorar los debates, han respondido activamente.

- Compromiso con la Ciencia Abierta: LMArena se define a sí misma como una plataforma con "políticas de leaderboard transparentes y basadas en la ciencia". Publican regularmente sus metodologías, liberan conjuntos de datos masivos para la comunidad investigadora (como un dataset de 140,000 conversaciones) y publican sus propias investigaciones sobre los sesgos de la plataforma.

- Mejoras Metodológicas: En respuesta a las críticas sobre la fragilidad estadística, han implementado mejoras significativas. En su "Leaderboard Changelog", anuncian cambios como el paso de bootstrapping a cálculos de intervalos de confianza más rápidos y la introducción de un esquema de reponderación (reweighting). Este último ajusta el peso de las batallas para contrarrestar el hecho de que los modelos más nuevos tienen menos votos, haciendo los rankings más justos y estadísticamente robustos.

- Reconocimiento de Limitaciones: El propio equipo de LMArena admite que su plataforma no es una panacea. Wei-Lin Chiang ha declarado que apoyan el uso de otras pruebas y que su objetivo es simplemente crear un espacio confiable que mida las preferencias de su comunidad.

Esta disposición a evolucionar y a participar en el debate académico es quizás la mayor defensa de LMArena. No se presentan como un juez infalible, sino como una herramienta en constante perfeccionamiento, comprometida con hacer el proceso de evaluación de la IA más abierto y democrático.

Conclusión: el futuro de la evaluación de IA en manos de la comunidad

LMArena ha trascendido su propósito original para convertirse en un fenómeno multifacético. Es, simultáneamente, una herramienta práctica y entretenida para el usuario curioso que desea saber qué IA es "mejor" para sus tareas, y una fuerza poderosa, aunque controvertida, que está definiendo activamente la narrativa, el marketing y la dirección técnica de toda una industria.

Su doble rol es innegable. Por un lado, democratiza la evaluación de la IA, sacándola de los confines de los laboratorios y poniéndola en manos de una comunidad global. Por otro, su sistema de ranking, a pesar de los esfuerzos por la neutralidad, crea incentivos comerciales que pueden generar sesgos y una carrera por "optimizar para el test" en lugar de para la utilidad genuina.

La evolución de LMArena de un proyecto de investigación de Berkeley a una empresa valorada en cientos de millones de dólares asegura que su influencia no hará más que crecer. Su futuro apunta hacia una mayor especialización, con arenas específicas para dominios como el derecho o la medicina, y un desafío constante por mantener la integridad científica frente a las crecientes presiones comerciales. La plataforma se enfrenta a la tarea monumental de equilibrar su rol como árbitro neutral con su modelo de negocio, que implica ofrecer servicios a las mismas empresas que evalúa.

En última instancia, el fenómeno LMArena nos deja una reflexión fundamental: en la era de la inteligencia artificial generativa, definir qué modelo es "mejor" es cada vez menos una cuestión de métricas técnicas puras y cada vez más un juicio complejo, multifactorial y profundamente subjetivo. Es un veredicto que, como demuestra LMArena cada día con millones de votos, está inextricablemente arraigado en la diversa y a veces caprichosa naturaleza de la preferencia humana.

Puntos clave del análisis

- ¿Qué es? LMArena es una plataforma de crowdsourcing que evalúa LLMs mediante batallas anónimas y votos de usuarios, utilizando el sistema de puntuación Elo.

- ¿Cómo se usa? Los usuarios introducen un prompt, comparan dos respuestas anónimas y votan por la mejor, revelándose después la identidad de los modelos.

- ¿Cómo mide la "inteligencia"? Utiliza el sistema Elo, un método de ranking relativo que se actualiza con cada voto y refleja la preferencia humana en tiempo real, superando las limitaciones de los benchmarks estáticos.

- ¿Cómo define la percepción?

- Para el público: Crea una narrativa deportiva fácil de seguir, generando titulares y viralizando modelos.

- Para desarrolladores: Sirve como campo de pruebas pre-lanzamiento y como una poderosa herramienta de marketing para validar la calidad de sus modelos.

- Psicológicamente: Revela que la preferencia no solo se basa en la precisión, sino también en el estilo, el tono emocional y la experiencia de la interacción.

- ¿Es imparcial? Se enfrenta a críticas de sesgo hacia grandes empresas, "overfitting" al leaderboard y dudas sobre la validez de su metodología. Sin embargo, responde con transparencia, publicando datos y mejorando constantemente sus métodos estadísticos.

- Conclusión: LMArena es una fuerza dual que democratiza la evaluación de la IA mientras moldea la industria, demostrando que la definición de "mejor" IA es, en última instancia, un juicio humano.