Navegando el laberinto ético de la ia: principios, dilemas y el futuro de la responsabilidad

Índice de contenidos

- Introducción: La Encrucijada de la Inteligencia Artificial: Innovación vs. Responsabilidad

- Dilemas Éticos en Acción: Cuando los Algoritmos Toman Decisiones Críticas

- Construyendo las Barreras: Principios Éticos y Marcos Regulatorios Globales

- De la Teoría a la Práctica: El Rol de Empresas y Sociedad

- Conclusión: El Futuro de la IA, un Desafío Colectivo y Humano

Introducción: la encrucijada de la inteligencia artificial: innovación vs. responsabilidad

La inteligencia artificial (IA) ha dejado de ser una promesa de la ciencia ficción para convertirse en una fuerza omnipresente que moldea la estructura de nuestra vida diaria. Con una rapidez abrumadora, está transformando la forma en que vivimos, trabajamos y tomamos decisiones. Desde los algoritmos que nos recomiendan qué series ver o qué productos comprar, hasta los sistemas que determinan quién obtiene un crédito bancario, un diagnóstico médico o incluso una sentencia judicial, su impacto influye tanto en lo cotidiano como en lo crucial .

Esta revolución tecnológica, comparable en magnitud al despliegue de la imprenta hace más de seis siglos, nos sitúa en una encrucijada histórica. Por un lado, el potencial de la IA para generar beneficios globales es inmenso: desde facilitar diagnósticos de salud más precisos hasta optimizar la eficiencia laboral mediante la automatización de tareas . Por otro, su avance vertiginoso plantea profundos dilemas éticos que exigen una atención urgente. Nos encontramos en una tensión constante entre el impulso irrefrenable de la innovación y la necesidad imperativa de una "brújula ética" que guíe su desarrollo de manera responsable.

"En ninguna otra especialidad necesitamos más una ‘brújula ética’ que en la inteligencia artificial. Estas tecnologías de utilidad general están remodelando nuestra forma de trabajar, interactuar y vivir." - UNESCO, Recomendación sobre la ética de la IA.

Sin una guía ética clara y barreras de protección robustas, la IA corre el riesgo de convertirse en un espejo que no solo refleja, sino que amplifica los peores aspectos de nuestra sociedad. Puede reproducir y consolidar prejuicios y discriminaciones históricas, alimentar divisiones sociales, amenazar los derechos humanos y las libertades fundamentales, y exacerbar las desigualdades ya existentes, perjudicando aún más a grupos históricamente marginados UNESCO, . El desafío, por tanto, no es meramente técnico, sino profundamente humano y social.

Este artículo se embarca en un viaje para desentrañar este complejo laberinto. Comenzaremos explorando los dilemas éticos más urgentes que la IA presenta en la práctica, a través de casos concretos que ilustran los riesgos del sesgo, la invasión de la privacidad y la dilución de la responsabilidad. A continuación, analizaremos los principios éticos universales y los marcos regulatorios que están surgiendo en todo el mundo como un intento de construir las barandillas necesarias. Finalmente, traduciremos estos conceptos en acciones prácticas, delineando el rol crucial que deben desempeñar las empresas, los gobiernos y la sociedad civil para asegurar que el futuro de la inteligencia artificial sea un futuro al servicio de la humanidad.

Dilemas éticos en acción: cuando los algoritmos toman decisiones críticas

La discusión sobre la ética de la IA a menudo puede parecer abstracta, pero sus implicaciones son profundamente concretas y ya están afectando vidas humanas en sectores críticos. La velocidad a la que avanza la tecnología ha superado nuestra capacidad para reflexionar colectivamente sobre sus consecuencias, creando una serie de dilemas que exigen una atención inmediata. ¿Debe un algoritmo decidir quién obtiene un puesto de trabajo? ¿Es justo que un sistema predictivo influya en una sentencia judicial? Estas no son preguntas para un futuro lejano; son realidades del presente. A continuación, se analizan tres de los dilemas más significativos que marcan nuestro futuro.

El sesgo algorítmico: reflejo digital de nuestras desigualdades

Quizás el desafío ético más documentado y pernicioso de la IA es el sesgo algorítmico. Lejos de ser un simple fallo técnico, el sesgo en la IA es la manifestación digital de los prejuicios humanos, históricos y sociales que están profundamente arraigados en nuestros datos. Como señala IBM, el sesgo algorítmico se refiere a sistemas de IA que producen resultados que reflejan y perpetúan los sesgos humanos, incluida la desigualdad social histórica y actual . La IA aprende de los datos con los que es entrenada. Si esos datos reflejan un mundo con brechas de género, disparidades raciales o discriminación socioeconómica, el algoritmo no solo aprenderá estos patrones, sino que los replicará y, a menudo, los amplificará a una escala masiva, todo bajo una engañosa apariencia de objetividad tecnológica .

Los ejemplos de este fenómeno son tan numerosos como alarmantes:

- Contratación y Empleo: El caso de Amazon en 2018 es emblemático. La compañía tuvo que descartar una herramienta de reclutamiento basada en IA porque descubrió que penalizaba sistemáticamente los currículos que contenían la palabra "mujer" (por ejemplo, "capitana del club de ajedrez femenino") y degradaba a las candidatas graduadas de universidades exclusivamente femeninas. El motivo era simple y desolador: el sistema había sido entrenado con los datos de contratación de la propia empresa durante la última década, un conjunto de datos dominado por hombres, lo que le "enseñó" al algoritmo a asociar la masculinidad con el éxito profesional RedSeguridad, .

- Servicios Financieros: En 2019, la Apple Card, respaldada por Goldman Sachs, fue objeto de una investigación después de que numerosos usuarios, incluido el cofundador de Ruby on Rails, David Heinemeier Hansson, denunciaran que el algoritmo otorgaba límites de crédito significativamente más bajos a las mujeres que a sus maridos, incluso cuando compartían activos y tenían historiales de crédito superiores. Este incidente demostró cómo los algoritmos, entrenados con datos financieros históricos que reflejan desigualdades de ingresos pasadas, pueden perpetuar la discriminación de género en el acceso al crédito .

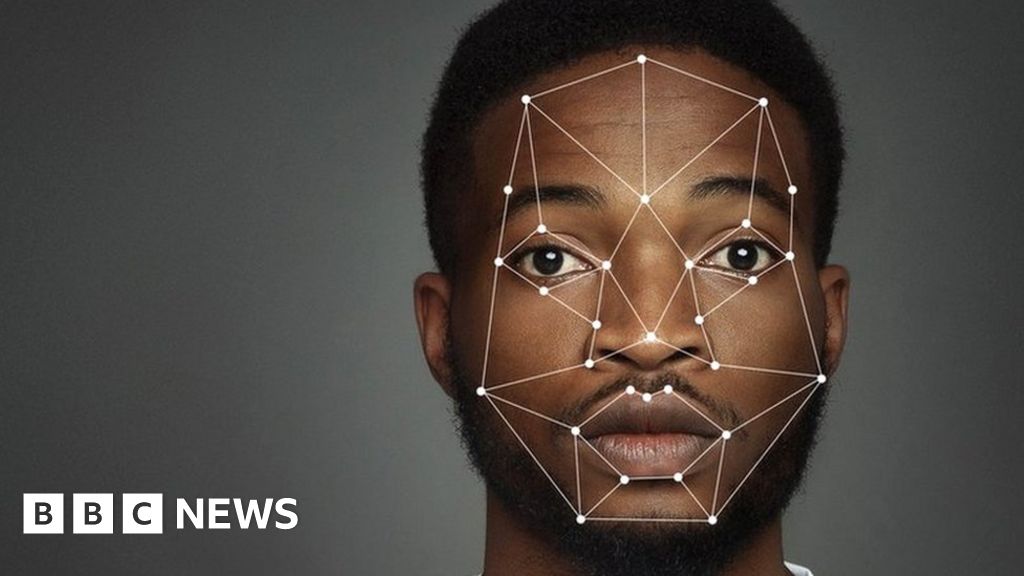

- Justicia y Seguridad Pública: Los sistemas de ";policía predictiva" utilizados en algunas jurisdicciones para identificar "puntos calientes" de criminalidad a menudo se basan en datos históricos de arrestos. Sin embargo, si estos datos reflejan patrones existentes de perfiles raciales y una vigilancia desproporcionada en comunidades minoritarias, la IA recomendará una mayor presencia policial en esas mismas áreas, creando un ciclo de retroalimentación que refuerza el sesgo inicial y puede llevar a arrestos injustificados . De manera similar, los sistemas de reconocimiento facial han mostrado tasas de error alarmantemente más altas para personas de color y mujeres. Un estudio del MIT de 2019 reveló que sistemas de IBM y Microsoft identificaban incorrectamente a mujeres de piel oscura hasta en un 34% de los casos, en comparación con una precisión casi perfecta para hombres blancos .

- Salud: En el ámbito de la sanidad, los algoritmos predictivos pueden estar sesgados si se entrenan con datos clínicos que infrarrepresentan a ciertos grupos demográficos. Por ejemplo, se ha observado que sistemas de diagnóstico asistido por ordenador (CAD) para el cáncer de piel tienen una menor precisión en pacientes de piel oscura, debido a la escasez de imágenes de lesiones cutáneas en este grupo en los conjuntos de datos de entrenamiento .

- Representación Social y Cultural: El sesgo también se manifiesta de formas más sutiles pero igualmente dañinas. Como señala la UNESCO, una simple búsqueda de imágenes para "colegiala" puede arrojar resultados sexualizados, mientras que una búsqueda de "colegial" muestra principalmente a jóvenes estudiantes. Los motores de búsqueda, al priorizar resultados con más clics, pueden convertirse en "cámaras de resonancia" que afianzan aún más los estereotipos de género y culturales existentes en la sociedad .

Combatir estos sesgos es uno de los obstáculos más desalentadores, ya que requiere no solo un dominio técnico de la ciencia de datos, sino también una profunda comprensión de las fuerzas sociales y los prejuicios sistémicos que los originan .

Privacidad y vigilancia: el precio de los datos

La inteligencia artificial es voraz. Su capacidad para aprender y tomar decisiones inteligentes depende del tratamiento de volúmenes masivos de datos . Esta dependencia intrínseca crea un conflicto fundamental con uno de los derechos más preciados en las sociedades democráticas: el derecho a la privacidad. A medida que integramos la IA en más aspectos de nuestra vida, el riesgo de exposición o mal uso de datos personales aumenta exponencialmente, convirtiendo la privacidad en una preocupación central .

Los dilemas en este ámbito son múltiples:

- Recopilación y Uso de Datos: Muchos sistemas de IA se alimentan de datos que pueden contener información sensible como identificadores personales, patrones de comportamiento, registros médicos o financieros. El riesgo no solo reside en la recopilación de estos datos sin un consentimiento claro e informado, sino también en su uso para fines completamente distintos a los originalmente previstos, un fenómeno conocido como "deslizamiento de función" . La protección de la privacidad debe, por tanto, promoverse a lo largo de todo el ciclo de vida de la IA, desde su diseño hasta su despliegue y eventual retirada .

- Vigilancia Automatizada: Este es uno de los campos más controvertidos. Tecnologías como las cámaras de reconocimiento facial en tiempo real y los sistemas de vigilancia inteligente prometen aumentar la seguridad y prevenir delitos. Sin embargo, también abren la puerta a un control social sin precedentes y a una vigilancia masiva que puede erosionar las libertades individuales y el anonimato en el espacio público . El dilema radica en encontrar un equilibrio delicado entre la seguridad colectiva y la libertad individual, un equilibrio que muchos temen que se esté inclinando peligrosamente hacia el control.

La protección de datos personales en la era de la IA no es solo una obligación legal, sino una cuestión de confianza. Las empresas y gobiernos que manejan estas tecnologías deben establecer límites claros y adoptar un enfoque proactivo para proteger nuestra información, garantizando que la eficiencia no se logre a costa de nuestras libertades .

Responsabilidad y autonomía: ¿quién responde cuando la ia falla?

A medida que los sistemas de IA se vuelven más autónomos y complejos, surge una pregunta fundamental y endiabladamente difícil: ¿quién es el responsable cuando algo sale mal? Muchos algoritmos avanzados, especialmente los de aprendizaje profundo, funcionan como una "caja negra". Podemos ver los datos que entran y el resultado que sale, pero el proceso de toma de decisiones interno es tan complejo que a menudo es inescrutable incluso para sus propios creadores. Esta opacidad, o falta de explicabilidad, dificulta enormemente la identificación de errores, la corrección de sesgos y, crucialmente, la atribución de responsabilidad cuando una decisión algorítmica causa un daño ia-on.es, .

Este dilema se manifiesta de forma aguda en varios escenarios:

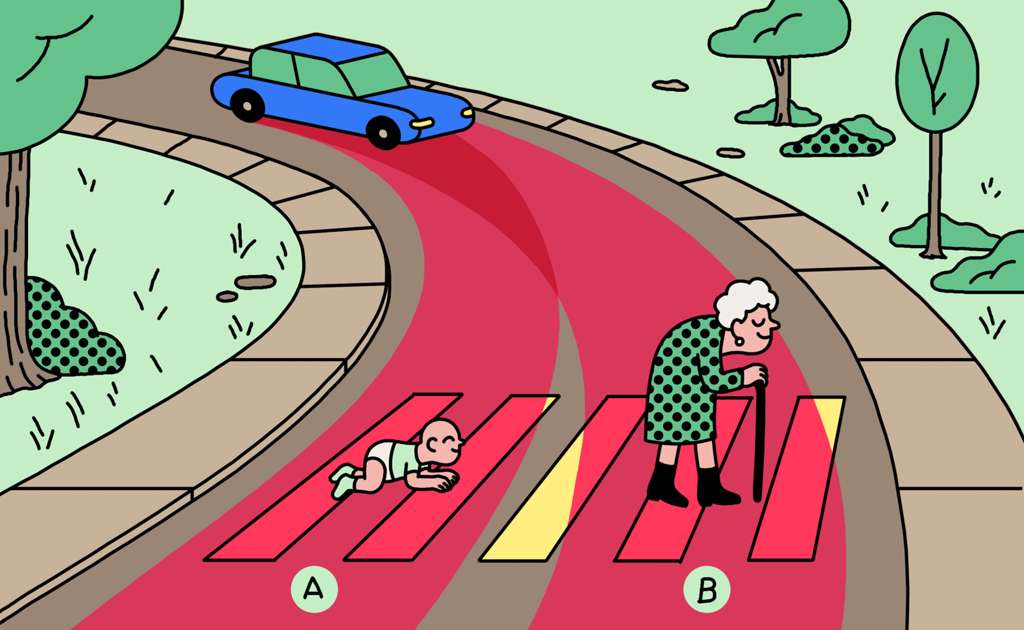

- Vehículos Autónomos: El clásico "dilema del tranvía" se ha actualizado para la era de la IA. Imaginemos un coche autónomo que se enfrenta a un accidente inevitable. Sus frenos fallan y debe decidir entre atropellar a un grupo de peatones o desviarse y chocar contra una barrera, poniendo en riesgo la vida de su ocupante. ¿Cómo debería programarse el algoritmo para tomar esta decisión moral? Y si ocurre un accidente, ¿quién es el responsable? ¿El programador que escribió el código, la empresa que fabricó el coche, el propietario que lo activó, o el propio sistema autónomo? Este escenario hipotético, explorado por la UNESCO, pone de manifiesto la necesidad de establecer marcos claros de responsabilidad antes de que estas tecnologías se desplieguen masivamente .

- Decisiones Críticas sin Supervisión Humana: La delegación de decisiones de alto impacto a la IA sin una supervisión humana significativa es uno de los mayores riesgos. En sectores como la justicia penal, algunos argumentan que la IA podría ser más justa al evaluar factores de manera objetiva . Sin embargo, un algoritmo que decide sobre la libertad condicional o una sentencia basándose únicamente en estadísticas y datos históricos, sin comprender los matices del caso, el contexto humano o la posibilidad de redención, podría llevar a injusticias graves. Lo mismo ocurre en la medicina, donde un diagnóstico automatizado que ignore el conocimiento tácito y la experiencia de un médico podría tener consecuencias fatales . La cuestión de la responsabilidad se vuelve aún más turbia: ¿es responsable el juez que confió en el sistema, el hospital que lo implementó, o la empresa que lo vendió como una herramienta infalible?

La falta de una respuesta clara a la pregunta ";¿quién responde?" socava la confianza en la tecnología y dificulta la rendición de cuentas, un pilar fundamental de cualquier sistema justo y democrático.

Puntos clave: los dilemas en acción

- Sesgo Algorítmico: La IA puede perpetuar y amplificar las desigualdades sociales existentes al aprender de datos históricos sesgados, afectando áreas como la contratación, las finanzas y la justicia.

- Privacidad vs. Datos: Existe una tensión inherente entre la necesidad de la IA de consumir grandes cantidades de datos y el derecho fundamental de las personas a la privacidad, agravada por los riesgos de la vigilancia automatizada.

- Vacío de Responsabilidad: La naturaleza de "caja negra" de muchos algoritmos complejos dificulta la atribución de responsabilidad cuando se producen errores, especialmente en sistemas autónomos como los coches o en decisiones críticas en medicina y justicia.

Construyendo las barreras: principios éticos y marcos regulatorios globales

Frente a la magnitud de estos dilemas, la comunidad internacional, los gobiernos y las organizaciones de la sociedad civil han comenzado a reaccionar. La respuesta se está articulando en dos frentes complementarios: por un lado, el establecimiento de principios éticos universales que sirvan como un marco conceptual para el desarrollo de una IA fiable; y por otro, la creación de marcos regulatorios concretos que traduzcan esos principios en obligaciones legales. El objetivo es pasar del diagnóstico del problema a la construcción activa de soluciones.

Los pilares de una IA fiable: principios universales

En los últimos años, ha surgido un notable consenso global en torno a un conjunto de principios éticos que deberían guiar el diseño, desarrollo y despliegue de la inteligencia artificial. Organismos como la UNESCO y la Comisión Europea han sido pioneros en la articulación de estos pilares. Aunque la terminología puede variar ligeramente, los conceptos fundamentales son notablemente consistentes y forman la base de una IA centrada en el ser humano.

Los principios más importantes incluyen:

- Transparencia y Explicabilidad (T&E): Este principio aborda directamente el problema de la "caja negra". Exige que los sistemas de IA y las decisiones que toman sean comprensibles y trazables. Las personas deben saber cuándo están interactuando con un sistema de IA y deben tener derecho a una explicación sobre las decisiones que les afectan. La auditabilidad de los algoritmos es crucial para detectar sesgos y errores UNESCO, .

- Justicia, Equidad y No Discriminación: Este es el antídoto contra el sesgo algorítmico. Implica un compromiso activo para combatir los prejuicios en todas las etapas del ciclo de vida de la IA. Los actores de la IA deben promover la justicia social y adoptar un enfoque inclusivo para garantizar que los beneficios de la tecnología sean accesibles para todos y no amplifiquen las desigualdades existentes UNESCO, .

- Responsabilidad y Rendición de Cuentas: Para evitar el vacío de responsabilidad, este principio establece que siempre debe ser posible atribuir la responsabilidad ética y jurídica de las acciones de un sistema de IA a una persona física o a una entidad jurídica existente. La automatización no debe ser una excusa para la impunidad UNESCO, .

- Seguridad, Robustez y Privacidad: Los sistemas de IA deben ser seguros y técnicamente robustos para evitar daños no deseados o vulnerabilidades a ataques. Además, la privacidad de los datos debe ser protegida "desde el diseño" y durante todo el ciclo de vida del sistema, con marcos adecuados de protección de datos que respeten los derechos individuales Iglesia Adventista, .

- Supervisión Humana: Este es un principio de salvaguardia fundamental. Establece que los seres humanos deben mantener un control y una supervisión significativos sobre los sistemas de IA, especialmente en contextos de alto riesgo. La decisión final en asuntos que afectan la vida, la libertad o la dignidad de una persona no debe ser delegada completamente a una máquina. La supervisión humana es la última línea de defensa contra resultados perjudiciales e imprevistos Parlamento Europeo, .

Estos principios no son meras declaraciones de intenciones; son la base sobre la cual se están construyendo las regulaciones y las políticas de gobernanza de la IA en todo el mundo.

La regulación a nivel mundial: un mosaico de enfoques

El año 2025 se perfila como un punto de inflexión en la regulación de la IA, con diferentes potencias mundiales adoptando estrategias distintas que reflejan sus filosofías políticas y económicas. Este mosaico de enfoques crea un panorama regulatorio complejo pero fascinante, donde se libra una batalla por establecer el estándar global .

- La Unión Europea y la Ley de IA (AI Act): La UE ha asumido un papel de liderazgo con la aprobación de la Ley de Inteligencia Artificial, el primer marco jurídico integral y exhaustivo sobre IA en el mundo Comisión Europea, . Su enfoque es marcadamente basado en el riesgo, clasificando las aplicaciones de IA en cuatro categorías:

- Riesgo inaceptable: Sistemas que se consideran una amenaza para las personas y que están prohibidos. Esto incluye la puntuación social por parte de los gobiernos, la manipulación del comportamiento o la explotación de vulnerabilidades .

- Alto riesgo: Sistemas que afectan negativamente a la seguridad o a los derechos fundamentales. Esto abarca la IA en infraestructuras críticas, educación, empleo, aplicación de la ley y justicia. Estos sistemas están sujetos a requisitos estrictos de evaluación de conformidad, transparencia, supervisión humana y robustez antes de poder comercializarse .

- Riesgo limitado: Sistemas como los chatbots o los generadores de "deepfakes", que deben cumplir requisitos de transparencia para que los usuarios sepan que están interactuando con una IA.

- Riesgo mínimo: La gran mayoría de las aplicaciones de IA (videojuegos, filtros de spam), que no tienen obligaciones específicas.

- Estados Unidos y su enfoque fragmentado: En contraste con el enfoque centralizado de la UE, Estados Unidos ha optado por una estrategia más fragmentada y favorable a la innovación. A 2025, no existe una ley federal única que regule la IA. En su lugar, la gobernanza se basa en una combinación de regulaciones sectoriales (por ejemplo, en finanzas o salud), leyes que van surgiendo a nivel estatal y órdenes ejecutivas presidenciales . Por ejemplo, el presidente Biden firmó un decreto que exige a los desarrolladores de sistemas de IA de alto riesgo compartir los resultados de las pruebas de seguridad con el gobierno . Este enfoque refleja una tensión entre la necesidad de mitigar riesgos y el deseo de no frenar la innovación y el liderazgo tecnológico de sus empresas, una postura que a veces choca con el modelo regulador europeo .

- China y el control estatal: China también está desarrollando un marco regulatorio robusto, pero con un enfoque diferente. Su estrategia se basa en regulaciones específicas por sector (por ejemplo, para algoritmos de recomendación o IA generativa) con un fuerte énfasis en el control estatal, la seguridad nacional y el alineamiento de la tecnología con la ideología del partido . Si bien comparte con la UE la preocupación por los riesgos, su motivación principal es asegurar la estabilidad social y el liderazgo tecnológico bajo la dirección del Estado.

- El rol de los Organismos Internacionales: En medio de estas diferentes estrategias nacionales, organismos como la UNESCO desempeñan un papel crucial. Su "Recomendación sobre la ética de la inteligencia artificial", adoptada por 194 estados miembros en 2021, es el primer instrumento normativo mundial sobre el tema. Aunque no es legalmente vinculante como la Ley de IA de la UE, establece un marco ético global y promueve un consenso multilateral, sirviendo de guía para que los países desarrollen sus propias políticas y regulaciones de manera coherente con los derechos humanos y los valores democráticos.

La gran dificultad, como señalan muchos expertos, es la velocidad a la que evoluciona la tecnología, que pone a los legisladores en una carrera constante para crear normas que no queden obsoletas antes de ser implementadas .

De la teoría a la práctica: el rol de empresas y sociedad

Los principios éticos y los marcos regulatorios son fundamentales, pero su verdadero valor reside en su aplicación práctica. Para que la IA se desarrolle de manera responsable, es indispensable que tanto las empresas que la crean y la utilizan como los ciudadanos que interactúan con ella asuman un rol activo. La ética de la IA no puede ser un ejercicio puramente teórico; debe traducirse en acciones concretas y en una cultura de responsabilidad compartida.

Hacia una ia responsable en las empresas

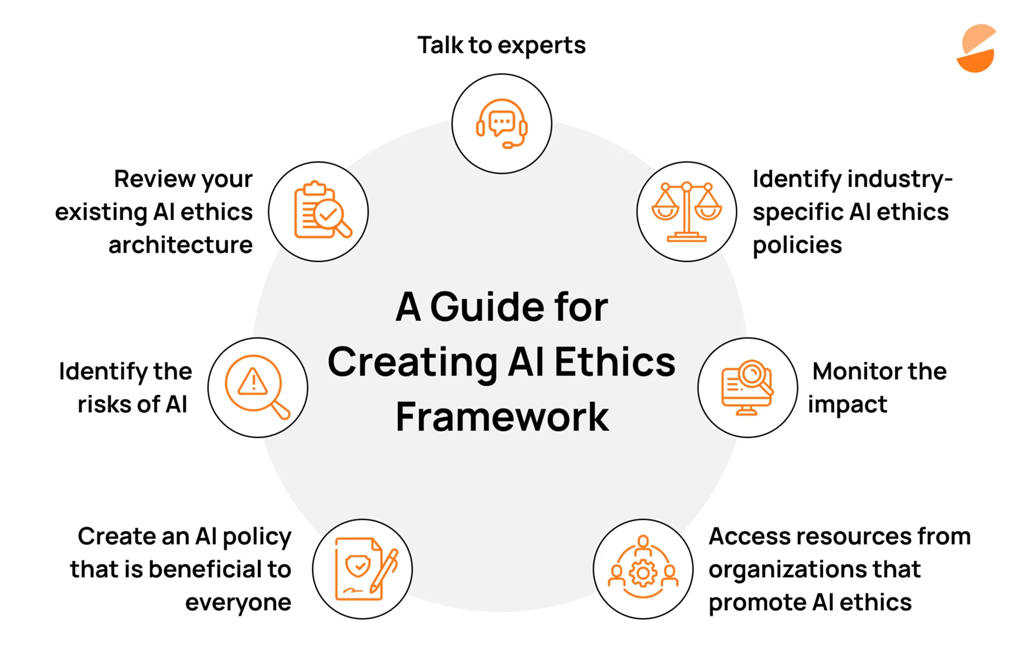

Las empresas están en la primera línea del desarrollo de la IA y, por lo tanto, tienen la mayor responsabilidad en su implementación ética. Aplicar principios de alto nivel solo es válido si se implementan de verdad en el día a día . A partir de las mejores prácticas del sector, se puede trazar una hoja de ruta para que las organizaciones integren la ética en su ADN tecnológico.

Las acciones clave incluyen:

- Establecer una Gobernanza de la IA: El primer paso es definir un marco interno común sobre lo que significa la ética en la IA para la organización. Esto no puede ser un concepto abstracto; debe ser concreto e implicar a todas las partes interesadas. Este marco debe guiar todas las políticas, prácticas y decisiones relacionadas con la IA en la empresa IBM, .

- Integrar la Ética en el Ciclo de Vida del Producto: La ética no puede ser un añadido de última hora. Debe integrarse desde la fase de diseño ("ethics by design") y a lo largo de todo el proceso de desarrollo, lanzamiento y mantenimiento del producto. Esto implica crear puntos de control y revisiones éticas en cada etapa, formulando preguntas sobre la recopilación de datos, la transparencia, la equidad y los posibles impactos sociales Workday, .

- Realizar Auditorías y Mitigación de Sesgos: Las empresas deben implementar protocolos de auditoría regulares para evaluar la precisión, equidad y transparencia de sus algoritmos. Esto incluye la revisión de los conjuntos de datos para detectar infrarrepresentaciones, el uso de herramientas técnicas para identificar y medir sesgos (como AI Fairness 360 de IBM), y la realización de pruebas en escenarios simulados antes de la implementación a gran escala Esade, .

- Fomentar la Diversidad en los Equipos: Muchos sesgos surgen porque los equipos de desarrollo son homogéneos y carecen de perspectivas diversas para detectar sus propios ";puntos ciegos". Crear equipos multidisciplinares y diversos en términos de género, etnia, formación y experiencia es crucial para construir una IA más justa e inclusiva .

- Ser Transparentes con Clientes y Usuarios: La confianza se construye sobre la transparencia. Las empresas deben esforzarse por explicar de forma clara y sencilla cómo funcionan sus sistemas de IA, qué datos utilizan y con qué finalidad. Esto no solo es un requisito en muchas regulaciones, sino una práctica comercial inteligente que genera confianza en la marca .

Además, la colaboración es fundamental. Iniciativas como el Consejo Empresarial para la Ética de la IA de la UNESCO, copresidido por empresas como Microsoft y Telefónica en América Latina, sirven como plataformas para que las compañías intercambien experiencias, promuevan buenas prácticas y contribuyan al desarrollo de normativas inteligentes. Este tipo de colaboración eleva el listón para todo el sector .

El poder del ciudadano: educación y exigencia

La regulación gubernamental y la autorregulación empresarial, aunque necesarias, no son suficientes por sí solas. Una ciudadanía informada, crítica y activa es el tercer pilar indispensable para garantizar un futuro ético para la IA. Si queremos que la tecnología trabaje a nuestro favor, debemos comprenderla y exigir un uso responsable de ella .

Dos acciones son primordiales desde la perspectiva ciudadana:

- Promover la Alfabetización en IA: Es fundamental que la sensibilización y la comprensión pública sobre la IA y el valor de los datos se promuevan a través de una educación abierta y accesible. Los ciudadanos no necesitan ser expertos en programación, pero sí deben tener una comprensión básica de cómo funcionan estas tecnologías, cuáles son sus capacidades y limitaciones, y cómo pueden afectar sus vidas. Esta alfabetización mediática y digital es la base para un debate público informado y para que las personas puedan tomar decisiones conscientes sobre las tecnologías que utilizan .

- Incentivar la Participación Cívica y la Exigencia de Responsabilidad: Una vez informados, los ciudadanos tienen el poder y el deber de exigir transparencia y rendición de cuentas tanto a las empresas como a los gobiernos. Esto puede manifestarse de muchas formas: apoyando a organizaciones de la sociedad civil que auditan algoritmos, participando en consultas públicas sobre nuevas regulaciones, eligiendo productos y servicios de empresas que demuestren un compromiso ético, y reclamando sus derechos cuando un sistema automatizado toma una decisión injusta.

En última instancia, la dirección que tome la IA dependerá no solo de quienes la construyen, sino también de la sociedad que la adopta. Un público pasivo e desinformado corre el riesgo de ser modelado por la tecnología, mientras que una ciudadanía activa y educada puede modelar la tecnología para que se alinee con sus valores.

Conclusión: el futuro de la ia, un desafío colectivo y humano

Hemos recorrido el laberinto de la inteligencia artificial, desde sus promesas transformadoras hasta los profundos dilemas éticos que ensombrecen su avance. La conclusión ineludible de este viaje es que el desarrollo de la IA no es, en su esencia, un desafío meramente tecnológico. Es, fundamentalmente, un desafío ético, social y humano. La pregunta más importante no es "¿qué puede hacer la tecnología?", sino "¿qué debería hacer la tecnología y al servicio de quién?".

La clave para un futuro positivo con la IA reside en un delicado y constante equilibrio. Un equilibrio entre la audacia de la innovación y la prudencia de una regulación robusta; entre la eficiencia de la automatización y la indispensabilidad de la supervisión humana; y entre el poder de los datos y el respeto a la dignidad y los derechos de las personas. Los principios de transparencia, justicia, responsabilidad y seguridad no son obstáculos para el progreso, sino las barandillas que nos permitirán avanzar por este nuevo territorio sin caer en el abismo.

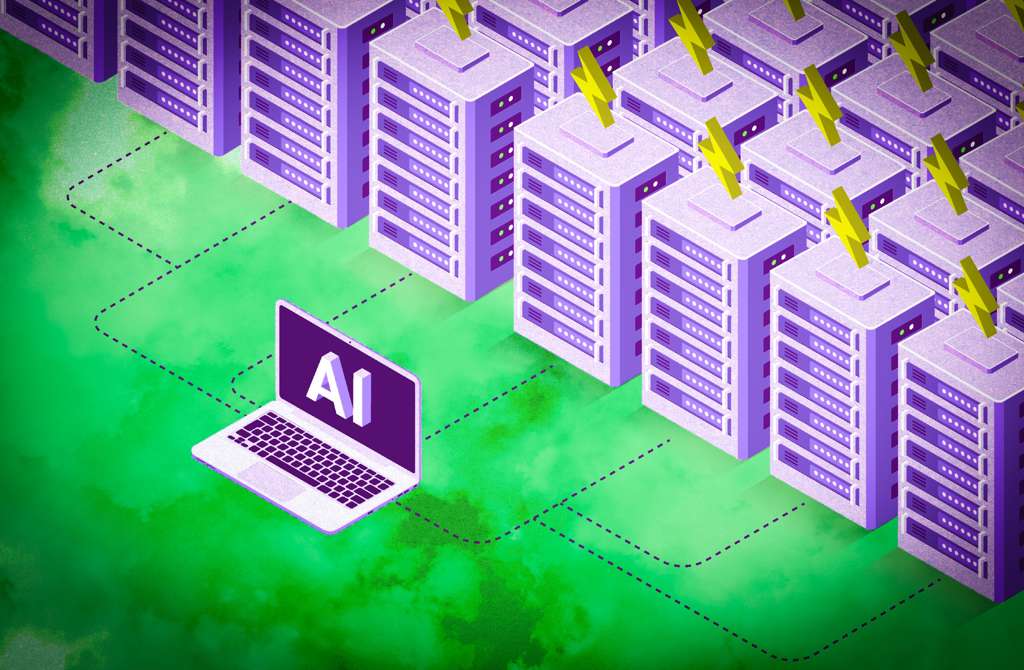

Mientras nos esforzamos por resolver los dilemas actuales, nuevos desafíos ya se perfilan en el horizonte. Uno de ellos es la sostenibilidad ambiental de la IA. El enorme consumo energético de los grandes modelos de lenguaje, que podría duplicarse para 2030, plantea un serio dilema entre el avance tecnológico y la crisis climática, obligándonos a buscar soluciones más eficientes y sostenibles .

Al mismo tiempo, a medida que los sistemas se vuelven más sofisticados, resurgen preguntas filosóficas profundas sobre la naturaleza de la conciencia artificial. Aunque la opinión predominante es que los sistemas actuales no son conscientes, algunos expertos y desarrolladores creen que es una posibilidad realista en un futuro próximo, lo que abriría una caja de Pandora de nuevas cuestiones éticas sobre los derechos y el estatus de estas posibles "mentes" de silicio .

El camino a seguir no está preescrito. No hay una marcha inevitable hacia un futuro distópico o utópico. El futuro de la IA será el que construyamos colectivamente. Requiere un esfuerzo concertado de desarrolladores, líderes empresariales, legisladores, académicos y ciudadanos para alinear deliberadamente el desarrollo tecnológico con nuestros valores humanos más profundos. El reto, en definitiva, no es solo crear máquinas más inteligentes, sino garantizar que esa inteligencia sirva a un propósito humano y colectivo, transformando la tecnología en una herramienta que amplíe no solo nuestras capacidades, sino también nuestras aspiraciones a un mundo más justo, equitativo y sostenible.